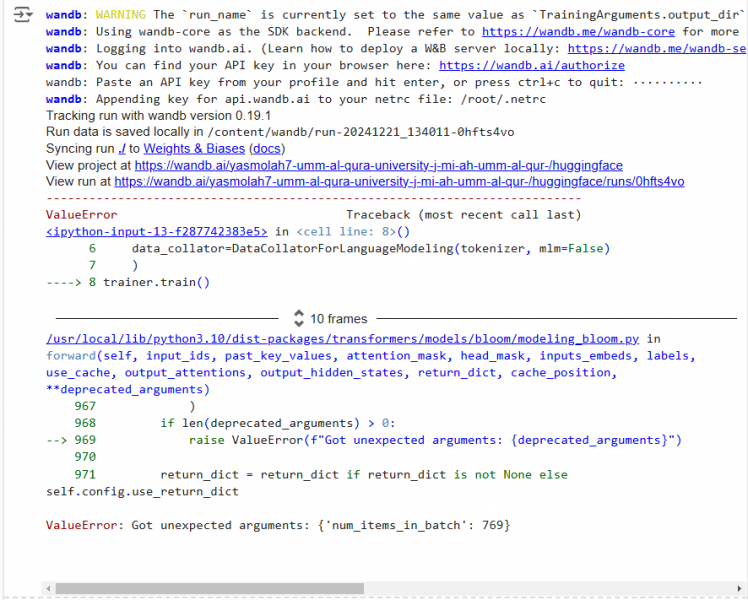

Yasmeen Almutaani نشر 21 ديسمبر 2024 أرسل تقرير نشر 21 ديسمبر 2024 يظهر لي هذا الخطأ ما سببه وكيف يمكن إصلاحه ؟ 2 اقتباس

0 ياسر مسكين نشر 21 ديسمبر 2024 أرسل تقرير نشر 21 ديسمبر 2024 لديك خطأ في إعداد التدريب ويتعلق بمعامل num_items_in_batch فالخطأ يظهر أن هناك وسيطة غير متوقعة بقيمة 769 لذا يمكن التحقق من أنّ إعدادات النموذج الخاص بك (model configuration) والتأكد من أن الـ batch size صحيح مثل التالي حيث حددناه ب 16: training_args = TrainingArguments( per_device_train_batch_size=16, ) ثم تعديل إعداد DataCollator للتأكد من عدم تمرير وسائط إضافية غير مطلوبة يمكنك تعديل السطر: data_collator=DataCollatorForLanguageModeling(tokenizer, mlm=False) بدلا منه نستخدم التالي: data_collator=DataCollatorForLanguageModeling( tokenizer=tokenizer, mlm=False, pad_to_multiple_of=8 ) في حال كنا سؤالك متعلقا بإحدى الدروس في إحدى الدورات أرجو طرح سؤالك هناك في أسفل الدرس حيث ستجدين صندوقا للتعليقات يمكنك طرح أسئلتك هناك. اقتباس

0 محمد عاطف25 نشر 21 ديسمبر 2024 أرسل تقرير نشر 21 ديسمبر 2024 الخطأ غالبا في إصدار مكتبة transformers حيث هذا بسبب أنه يوجد مشكلة في أحدث إصدار في المكتبة لذلك يرجى تنفيذ الأمر التالي : pip install transformers==4.45.2 sentence-transformers==3.1.1 إذا كان هذا السؤال خاص بدروس من دروس الدورات فيرجى مستقبلا وضع السؤال أسفل الدرس حيث ستجدين أسفل فيديو الدرس صندوق للتعليقات كما هنا يرجى طرح سؤالك أسفل الدرس وليس هنا حيث هنا قسم الأسئلة العامة ولا نقوم بإجابة الأسئلة الخاصة بمحتوى الدورة أو الدرس، وذلك لمعرفة الدرس الذي توجد به مشكلتك و لمساعدتك بشكل أفضل. اقتباس

السؤال

Yasmeen Almutaani

يظهر لي هذا الخطأ

ما سببه وكيف يمكن إصلاحه ؟

2 أجوبة على هذا السؤال

Recommended Posts

انضم إلى النقاش

يمكنك أن تنشر الآن وتسجل لاحقًا. إذا كان لديك حساب، فسجل الدخول الآن لتنشر باسم حسابك.